Alors que l’est de la République démocratique du Congo demeure confronté à une insécurité persistante liée à la présence active de groupes armés, le président Félix Tshisekedi continue de réaffirmer son engagement à rétablir la paix dans le pays.

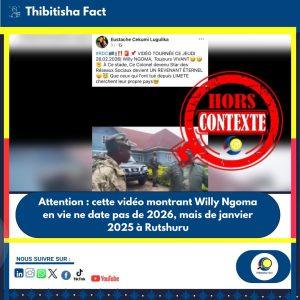

C’est dans ce contexte particulièrement tendu qu’une vidéo publiée le 1er juillet a commencé à circuler massivement sur les réseaux sociaux. On y voit le chef de l’État congolais, aux côtés de la Première Dame Denise Nyakeru, semblant déclarer qu’il n’a pas les moyens d’organiser les élections et qu’il restera au pouvoir jusqu’à ce que la paix soit entièrement restaurée.

Pour en vérifier l’authenticité, Thibitisha Fact a contacté Tina Salama, porte-parole du président, et mené une analyse approfondie à l’aide d’outils spécialisés comme Google Lens, permettant de retracer l’origine des images, et Hive Moderation, conçu pour détecter les contenus générés par intelligence artificielle.

Les résultats sont sans équivoque : la vidéo est falsifiée. Elle repose sur des images d’archives remontant à 2020, auxquelles a été ajouté un faux discours généré par intelligence artificielle. Aucun des propos attribués au président dans cette séquence ne correspond à une déclaration officielle. Il s’agit donc d’un deepfake, une vidéo manipulée visant à tromper le public.

Les propos attribués au président

Dans la vidéo devenue virale, le président de la République démocratique du Congo, Félix Tshisekedi, semble déclarer :

« Je n’aurai pas les moyens d’organiser les élections. Par conséquent, je resterai au pouvoir jusqu’à ce que la paix soit totalement restaurée au Congo ».

La Première Dame, Denise Nyakeru, y apparaît également, affirmant :

« Mon mari vous dit la vérité. Ayez foi en lui. Tant qu’il restera au pouvoir, le Congo sera fort, développé et souverain. Tous les moyens ont été mobilisés pour mettre fin à la guerre. La guerre est finie, nous avons vaincu notre ennemi. Maintenant, nous resterons au pouvoir pour développer le pays. Ceux qui ne seront pas contents… la porte est ouverte ».

Cette vidéo, (Lien archivée ici), a été publiée sur le compte TikTok de Junior Africa ( Lien Archivé ici). Elle a enregistré 209 500 vues, 9 039 mentions « j’aime », 1 019 commentaires et 4 446 partages à la date du mardi 29 juillet

Des internautes convaincus par la vidéo

En consultant les commentaires sous la publication, on constate que de nombreux internautes ont cru à la véracité du message relayé dans la vidéo.

Certains expriment même leur soutien au président :

« Nous, les Katangais, nous sommes d’accord avec vous. Fatshi béton jusqu’en 2094 ».

D’autres considèrent cette déclaration comme une réalité établie :

« C’est la vérité, nous sommes d’accord. Fatshi restera toujours béton. Si tu n’es pas content, va chercher ton président ailleurs ».

Démenti de la présidence

Contactée par Thibitisha Fact, la porte-parole du président Félix Tshisekedi, Tina Salama, a formellement démenti l’authenticité de la vidéo. Selon elle, il s’agit clairement d’un contenu fabriqué numériquement.

« Cette vidéo est une production de l’intelligence artificielle », a-t-elle déclaré

Une vidéo d’archives recyclée

Grâce à la recherche par image inversée effectuée avec l’outil Google Lens, nous avons soumis une capture d’écran tirée de la vidéo. Le résultat nous révèle qu’il s’agit d’une ancienne vidéo publiée à la veille du 25 décembre 2020, à l’occasion de la traditionnelle cérémonie présidentielle de Noël.

Dans cette vidéo (lien archivé ici), on voit le président Félix Tshisekedi adresser ses vœux et souhaiter le meilleur au peuple congolais après une année marquée par la crise sanitaire liée à la COVID-19.

Il déclare notamment :

« Très chers compatriotes, ce Noël 2020 n’a pas été facile. Une année perturbée par une crise sanitaire d’une ampleur que nous avons rarement connue… » Il est important de souligner que dans l’intégralité de cette vidéo, aucune déclaration n’indique que le président renonce à l’organisation des élections au nom de la paix. Par ailleurs, la version que nous avons retrouvée sur Facebook provient de la page du média Actualités.cd et date bien de 2020.

Un audio généré par intelligence artificielle

Pour renforcer notre enquête, nous avons soumis la vidéo à Hive Moderation, un outil spécialisé dans la détection des contenus générés par intelligence artificielle. Grâce à une analyse approfondie de la séquence incluant la voix, le mouvement des lèvres et la cohérence audio-visuelle l’algorithme a conclu à 94,1 % de probabilité que la vidéo soit une production générée par IA. Ce résultat confirme que le discours attribué au président n’est pas authentique. Il s’agit d’un deepfake, construit à partir d’images d’archives combinées à un faux audio synthétique.

Verdict

La vidéo montrant le président Félix Tshisekedi déclarant qu’il ne pourra pas organiser les élections et qu’il restera au pouvoir jusqu’au rétablissement total de la paix est fausse. Elle résulte d’un montage manipulé : les images proviennent d’une ancienne allocution de Noël datant de décembre 2020, à laquelle a été ajouté un faux discours généré par intelligence artificielle. L’analyse technique via Hive Moderation a confirmé, avec un taux de certitude de 94,1 %, que l’audio est synthétique. Aucun propos officiel du président ne corrobore les affirmations relayées dans cette séquence. Il s’agit donc d’un deepfake conçu pour tromper le public. Dans un contexte politique fragile, ce type de contenu peut semer la confusion et alimenter la méfiance. Il est essentiel de rester vigilant face à ce genre de manipulation et d’avoir le réflexe de vérifier toute information douteuse auprès de sources fiables.

Partager

Laisser un commentaire